Искусственный интеллект «рисует» войну в Украине. Это плохо для нас?

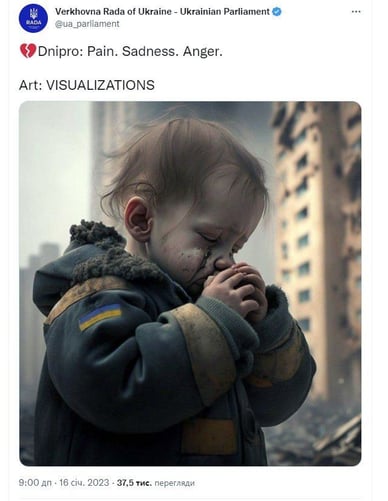

Маленький ребенок с нахмуренными бровями и слезами, катящимися по щечкам, черным от пыли, осевшей на лице, и в зимней курточке. На фоне — одна из многоэтажек, поврежденных войной. Простая подпись: «Днепр».

Это фото облетело соцсети после очередной российской атаки, унесшей жизни десятков наших людей. Но это фейк, красивая картинка, сгенерированная искусственным интеллектом. Почему эта работа обеспокоила людей и какие этические вопросы об искусственном интеллекте подняла — разбиралось hromadske.

В последние годы невероятные возможности ИИ пытаются применить в самых разных сферах. Но, похоже, людям интереснее, когда искусственный интеллект используется в творчестве. Дописать десятую симфонию Бетховена, «снять» фильм, переписать Библию в БДСМ-стиле — все это оказалось по силам ИИ. Не без нюансов, конечно.

Настоящий бум популярности искусственного интеллекта произошел в 2022 году, когда пользователи получили доступ к инструментам, которые могут генерировать любые изображения по текстовому описанию.

Сама система преобразования «текста в картинку» существует уже давно. Принцип таков: ИИ собирает обширные наборы данных для анализа и выдает определенный результат. Инструменты с возможностями, которые у нас есть сегодня, до сих пор были доступны только компаниям. К примеру, Imagen от Google остается закрытой. А для доступа к DALL·E от OpenAI нужно было становиться в длинный список ожидания.

К тому же, разработчики не спешат обнародовать свой код или делиться данными, на которых были обучены их инструменты. Исключением стал Stable Diffusion от Stability AI, доступ к которому — открытый и бесплатный.

Так постепенно возможности ИИ-искусства перешли в руки энтузиастов, которые начали воплощать «на холсте» свои самые абсурдные идеи.

Этическая сторона вопроса

Поскольку ранее доступ к таким инструментам ИИ имели компании, в них вводили «корпоративные фильтры»: никакой порнографии и насилия.

У Stable Diffusion фильтров не было. Это позволило генерировать изображение с любым содержимым. Такие возможности могли навредить другим людям, например звездам, поэтому через три месяца после «премьеры» разработчики выпустили обновление с фильтром на NSFW.

Другой вопрос к ИИ-искусству, который вызвал много возмущения со стороны художников, — сохранение авторских прав. Для создания новых изображений ИИ «скармливают» картины, фото, иллюстрации, уже сделанные людьми.

Работы имеющего узнаваемый стиль цифрового художника и блогера Сэм Янга (SamDoesArts) неоднократно становились «вдохновением» для ИИ. Он рассказал, что на создание работ в собственном стиле уходят сотни часов. Однако с появлением работ по мотивам его творчества в ИИ люди начали спрашивать, не являются ли его собственные работы сгенерированными.

Польский концептуальный художник Грег Рутковский, известный своими эпическими фантастическими картинами, также стал жертвой ИИ. Его стиль теперь — одна из наиболее используемых подсказок в Stable Diffusion. Он рассказал, что находит в интернете десятки ссылающихся на него картин, созданных ИИ, и беспокоится, что уже вскоре среди них не сможет найти свои.

Чтобы как-то помочь этому, создали инструмент Have I Been Trained? («На мне тренировались?»), чтобы помочь художникам узнать, были ли их произведения искусства среди «скормленных» искусственному интеллекту.

В борьбе за защиту авторских прав против разработчиков ИИ уже начались первые судебные процессы. Американское фотоагентство Getty Images судится с Stability AI. А группа художников и юристов подали в суд на Microsoft, ее «дочку» GitHub и OpenAI из-за GitHub Copilot — ИИ-инструмента, помогающего программистам писать код. Истцы говорят о «пиратстве программного обеспечения в беспрецедентных масштабах».

ИИ «рисует» войну в Украине

Эта фотография ребенка облетела соцсети, когда спасатели еще искали реальных пострадавших под обломками днепровской многоэтажки, уничтоженной российской ракетой. В соцсетях уже распространились первые страшные кадры разбитого здания; людей, кричавших под обломками; жителей уничтоженных квартир, сигнализировавших о помощи фонариками.

Официальная страница Верховной Рады опубликовала изображение «ребенка из Днепра» с подписью: «Art: VISUALIZATIONS». Сообщение сразу набрало просмотры, а также комментарии о неуместности публикации. Пресс-служба парламента его удалила, но изображение уже появилось в других сообществах и аккаунтах. К примеру, на странице посла Украины в Японии Сергея Корсунского.

В Facebook изображение набрало еще больше просмотров, а также сочувствующих комментариев от украинцев, которые считают, что и «фото», и «ребенок» на нем реальные.

«Боже, возьми этого ребенка под свою опеку»; «Такой маленький невинный ангелочек, это чье-то маленькое солнышко...»; «Боже, молю, пусть это будет последняя ракета. Дай этому ребенку и всем остальным выдержать это», — только часть комментариев под такими сообщениями.

Из уточнения ВР о «визуализации» изображения многие сделали выводы, что это работа ИИ. Следовательно, для создания картины о месте очередного российского удара по Украине искусственный интеллект мог «вдохновиться» реальными фото.

Впрочем, проблема даже не в том, что за почти год войны и активной борьбы с фейками украинцы не распознают ненастоящее фото. А то, что после разъяснения ошибки некоторым все равно, настоящее ли оно.

«Это же близнец распятого мальчика в трусиках, которого тоже придумал своего рода искусственный интеллект — российская пропаганда, а затем даже после всех разоблачений и признаний мифологема распятого мальчика вдохновляла российских люмпенов на ненависть к Украине. Потому что если этого придумали, то другого точно распяли», — пишет медиакритик Отар Довженко.

Распространение, а затем опровержение «фото ребенка из Днепра» также дает основания пропагандистам продвигать нарратив о «фейках из Украины», а рядовым иностранцам сомневаться в реальности сообщений.

«Мальчик из Днепра», как ни странно, не стал первым изображением ИИ на тему войны в Украине. Стартап Sirens запустил проект, где нейросеть генерирует художественные работы о важных событиях российско-украинской войны — битве за аэропорт в Гостомеле, атаке на остров Змеиный, подписании лен-длиза Джо Байденом и т.д.

Есть в галерее и работы, иллюстрирующие особенно болезненные для украинцев темы: обстрел Драмтеатра в Мариуполе и начало блокады города.

Некоторые картины имеют очевидное сходство с реальными фото из Украины, которые уже облетели весь мир и вошли в историю. Среди них — «Освобождение Киевской области», напоминающее фото из Бучи, и «Герои Азовстали держали оборону Мариуполя 85 дней», которая схожа со знаменитым фото Дмитрия «Ореста» Козацкого.

Зачем эти картины? Авторы проекта рассказывают, что продают их как NFT, а собранные средства передают на гуманитарную помощь Украине: помощь жертвам войны и восстановление пострадавших городов.

Это не единственный случай визуализации войны в Украине с помощью искусственного интеллекта. Насколько этично такое применение «ИИ-искусства» во время активной информационной войны — вопрос открытый.

- Поделиться: